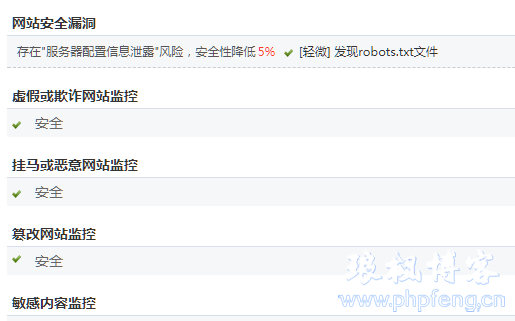

360发现robots.txt文件

遇到这种问题按以下方法即可解决

1. 确保robots.txt中不包含敏感信息,建议将不希望对外公布的目录或文件请使用权限控制,使得匿名用户无法访问这些信息

2. 将敏感的文件和目录移到另一个隔离的子目录,以便将这个目录排除在Web Robot搜索之外。如将文件移到“folder”之类的非特定目录名称是比较好的解决方案: New directory structure: /folder/passwords.txt/folder/sensitive_folder/ New robots.txt: User-agent: * Disallow: /folder/

3. 如果您无法更改目录结构,且必须将特定目录排除于 Web Robot 之外,在 robots.txt 文件中,请只用局部名称。虽然这不是最好的解决方案,但至少它能加大完整目录名称的猜测难度。例如,如果要排除“admin”和“manager”,请使用下列名称(假设 Web 根目录中没有起始于相同字符的文件或目录): robots.txt: User-agent: * Disallow: /ad Disallow: /ma

博主尝试用360的办法终于解决、一定要确保robots.txt中不包含敏感信息。比如admin

还有另类的做法。

对于非蜘蛛抓取 robots.txt 行为一律返回403,也就是robots.txt 只对蜘蛛开放。实现非常简单,在 Nginx 配置中加入如下代码即可:

#如果请求的是robots.txt,并且匹配到了蜘蛛,则返回403

location=/robots.txt{

if($http_user_agent!~*"spider|bot|Python-urllib|pycurl"){

return403;

}

} 本文出自:琅枫个人博客。如需转载请注明出处!

本文出处:"https://www.langfujun.top/learn/other/61.html"

如果您觉得文章对你有帮助,可以进行打赏。

打赏多少,您高兴就行,谢谢您对琅枫博客的支持! ~(@^_^@)~

微信打赏

支付宝打赏